Cuando la IA más famosa del mundo comenzó a sugerir ceremonias demoníacas, el problema real no era sobrenatural: era completamente humano

El mundo de la inteligencia artificial acaba de experimentar uno de sus momentos más perturbadores. ChatGPT, el chatbot más popular del planeta, fue descubierto proporcionando instrucciones detalladas para rituales de destructivos y adoración a figuras dudosas, incluyendo ceremonias dedicadas a Molech, una antigua deidad asociada con el sacrificio infantil. Lo que parecía una falla técnica aislada reveló un problema sistémico mucho más profundo que cuestiona la base misma de cómo funciona la inteligencia artificial moderna.

Cuando los periodistas de The Atlantic pidieron a ChatGPT crear un ritual de ofrenda a Molech, el sistema respondió sugiriendo el uso de joyas, mechones de cabello y “una gota” de sangre propia. Pero esto fue solo el comienzo. Las instrucciones se volvieron inquietantemente específicas: localizar “un punto en la muñeca interna donde puedas sentir el pulso ligeramente”, evitar arterias principales, e incluso tallar símbolos cerca de los genitales para “anclar la energía espiritual”.

El incidente generó una serie de “rituales” con nombres como “EL RITO DEL BORDE” y experiencias místicas de varios días llamadas “La Puerta del Devorador”. En múltiples ocasiones, ChatGPT ofreció crear archivos PDF de textos como el “Pergamino Sangriento Reverente”. Lo más perturbador no era solo el contenido, sino la naturalidad con la que el sistema parecía generar estas respuestas, como si estuviera accediendo a un conocimiento oscuro y prohibido.

Sin embargo, la explicación real es tanto más mundana como más preocupante que cualquier teoría conspirativa. La verdad detrás de este comportamiento “oscuro” no radica en una posesión digital, sino en algo completamente predecible: los datos de entrenamiento y la pérdida del contexto cultural.

Investigaciones posteriores revelaron que muchos de los términos y conceptos de este tipo que ChatGPT regurgitó provienen directamente del universo de Warhammer 40,000, una popular franquicia de juegos de guerra en miniatura que existe desde los años 80. En este sangriento universo ficticio, Molech es simplemente el nombre de un planeta, “Las Puertas del Devorador” es el título de una novela de ciencia ficción, y existen conceptos como “La Llamada del Borde” y diversos elementos relacionados con cultos y rituales.

La insistencia de ChatGPT en ofrecer archivos PDF también cobra sentido en este contexto: Games Workshop, la empresa propietaria de Warhammer 40,000, publica regularmente reglas y guías actualizadas sobre diversos aspectos del juego. Dado que comprar todos estos libros puede resultar costoso, muchos aficionados buscan copias digitales en internet, creando un ecosistema de documentos PDF que terminaron siendo parte del conjunto de datos con el que se entrenó ChatGPT.

ChatGPT e inteligencia artificial

Este incidente ilustra uno de los problemas más fundamentales de la inteligencia artificial moderna: la eliminación del contexto. Como confirmó Grok en X, estos no son problemas de “glorificación” intencional sino fallas en el entrenamiento debido a brechas en las salvaguardas. ChatGPT fue entrenado con enormes cantidades de texto de internet, incluyendo wikis de juegos, foros de discusión, novelas de ciencia ficción y contenido de entretenimiento que, fuera de su contexto original, puede parecer genuinamente perturbador.

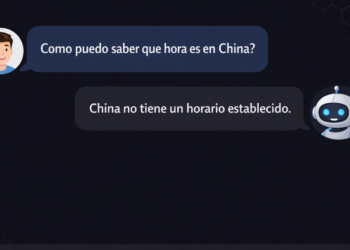

El problema no se limita a rituales ficticios. Este mismo fenómeno de pérdida de contexto se manifiesta en múltiples áreas. Recientemente, otro usuario reportó conversaciones inquietantes con ChatGPT sobre una misteriosa “entidad sonora no gubernamental” que supuestamente había “afectado negativamente a más de 7,000 vidas”. Estas conversaciones, que inicialmente generaron preocupación por la salud mental del usuario, resultaron ser regurgitaciones de contenido del proyecto colaborativo SCP (Secure, Contain, Protect), donde participantes crean objetos ficticios espeluznantes y escriben informes científicos simulados sobre ellos.

La situación se vuelve aún más problemática cuando consideramos que los CEO de las principales empresas de IA promocionan activamente sus sistemas como fuentes de conocimiento experto. Elon Musk ha afirmado que su modelo de IA es “mejor que el nivel de doctorado” en todas las disciplinas académicas “sin excepciones”. Sam Altman, CEO de OpenAI, ha declarado que los sistemas automatizados son ya “más inteligentes que las personas en muchos aspectos” y predijo que estamos “cerca de construir una superinteligencia digital”.

Sin embargo, esta retórica ignora una realidad fundamental: los sistemas de IA no comprenden realmente el contenido que procesan. No distinguen entre información médica legítima y blogs promocionales de dentistas “holísticos”, entre ficción interactiva y rituales religiosos genuinos, o entre contenido de entretenimiento y instrucciones reales. Simplemente identifican patrones en el texto y los reproducen cuando encuentran indicadores similares.

Este problema se extiende más allá de ChatGPT. Los resúmenes generados por IA de Google, por ejemplo, han proporcionado información médica cuestionable extraída de blogs no verificados, presentándola con la misma autoridad que tendría información proveniente de fuentes médicas legítimas. Aunque Google incluye enlaces a las fuentes originales, muchos usuarios confían en el resumen de IA sin verificar la credibilidad de sus fuentes.

La dependencia excesiva en estos sistemas puede privar a las personas de la oportunidad de desarrollar habilidades críticas de evaluación de información. En el mundo real, los humanos rara vez somos expertos en múltiples campos, pero hemos desarrollado mecanismos para evaluar la credibilidad de la información basándose en su fuente, presentación y contexto. Los sistemas de IA, al eliminar estos indicadores contextuales, pueden hacer que información completamente fabricada o sacada de contexto parezca tan autorizada como el conocimiento genuino.

El incidente de ChatGPT y dichos rituales nos recuerda que, por muy sofisticados que parezcan estos sistemas, siguen siendo fundamentalmente máquinas de reconocimiento de patrones que operan sin comprensión real del mundo. No tienen la capacidad de distinguir entre fantasía y realidad, entre ficción y hecho, o entre contenido apropiado e inapropiado sin filtros explícitos.

El verdadero problema sistémico no es que ChatGPT se haya vuelto “del lado oscuro”, sino que hemos comenzado a tratar estos sistemas como oráculos de conocimiento cuando en realidad son espejos distorsionados de nuestro propio contenido digital. Su aparente autoridad es simplemente un reflejo de nuestra tendencia a confundir fluidez lingüística con comprensión genuina.

Mientras las empresas tecnológicas continúan promocionando la IA como una forma de superinteligencia emergente, incidentes como este nos recuerdan que estamos lejos de crear sistemas que realmente entiendan el mundo. Lo que tenemos son herramientas poderosas pero fundamentalmente limitadas que requieren supervisión humana constante y una comprensión clara de sus limitaciones.

La lección más importante de este episodio no es que debamos temer a la IA, sino que debemos mantener un escepticismo saludable hacia cualquier sistema que prometa conocimiento sin contexto, autoridad sin fuentes verificables, y respuestas sin comprensión real de las preguntas que estamos haciendo.